Optyka i teoria informacji

Generalne obserwacje

Nowa era optyki rozpoczęła się na początku lat 50. XX wieku po wpływie niektórych gałęzi elektrotechniki - przede wszystkim teorii komunikacji i informacji. Impuls ten został podtrzymany przez rozwój lasera w latach 60.

Początkowy związek między optyką a teorią komunikacji nastąpił z powodu licznych analogii między dwoma przedmiotami oraz z powodu podobnych technik matematycznych zastosowanych do formalnego opisu zachowania się obwodów elektrycznych i układów optycznych. Od czasu wynalezienia soczewki jako urządzenia do obrazowania optycznego zawsze istotnym zagadnieniem był opis układu optycznego, który tworzy obraz; informacje o obiekcie są przekazywane i przedstawiane jako obraz. Oczywiście system optyczny można uznać za kanał komunikacyjny i jako taki można go analizować. Istnieje liniowa zależność (tj. Bezpośrednia proporcjonalność) między rozkładem natężenia w płaszczyźnie obrazu a tym istniejącym w obiekcie, gdy obiekt jest oświetlony światłem niespójnym (np. Światło słoneczne lub światło z dużego źródła termicznego). Dlatego teorię liniową opracowaną do opisu układów elektronicznych można zastosować w układach optycznego tworzenia obrazu. Na przykład obwód elektroniczny można scharakteryzować poprzez reakcję impulsową - to znaczy jego moc wyjściową dla krótkiego impulsu wejściowego prądu lub napięcia. Analogicznie układ optyczny może charakteryzować się odpowiedzią impulsową, która dla niespójnego układu obrazowania stanowi rozkład intensywności na obrazie punktowego źródła światła; impuls optyczny jest raczej impulsem przestrzennym niż czasowym - w przeciwnym razie koncepcja jest taka sama. Gdy znana jest odpowiednia funkcja odpowiedzi impulsowej, moc wyjściową tego układu dla dowolnego rozkładu intensywności obiektu można określić przez liniową superpozycję odpowiedzi impulsowych odpowiednio ważoną wartością intensywności w każdym punkcie obiektu. Dla ciągłego rozkładu intensywności obiektu suma ta staje się całką. Chociaż ten przykład podano w odniesieniu do optycznego systemu obrazowania, który jest z pewnością najczęstszym zastosowaniem elementów optycznych, koncepcja może być stosowana niezależnie od tego, czy płaszczyzna odbiorcza jest płaszczyzną obrazu, czy nie. Stąd, na przykład, odpowiedź impulsowa może być zdefiniowana dla układu optycznego, który jest celowo rozogniskowany lub dla systemów używanych do wyświetlania wzorów dyfrakcyjnych Fresnela lub Fraunhofera. (Dyfrakcja Fraunhofera występuje, gdy źródło światła i wzory dyfrakcyjne znajdują się skutecznie w nieskończonych odległościach od układu dyfrakcyjnego, a dyfrakcja Fresnela występuje, gdy jedna lub obie odległości są skończone).

Czasowa charakterystyka częstotliwościowa

Zasadniczo powiązaną, ale inną metodą opisywania działania obwodu elektronicznego jest jego czasowa odpowiedź częstotliwościowa. Powstaje wykres odpowiedzi dla szeregu sygnałów wejściowych o różnych częstotliwościach. Odpowiedź mierzona jest jako stosunek amplitudy sygnału uzyskanego z systemu do tego wprowadzonego. Jeśli nie ma strat w systemie, wówczas odpowiedź częstotliwościowa jest jednością (jedną) dla tej częstotliwości; jeśli określona częstotliwość nie przejdzie przez system, wówczas odpowiedź wynosi zero. Ponownie, analogicznie układ optyczny można również opisać definiując przestrzenną odpowiedź częstotliwościową. Obiekt, który ma być zobrazowany przez układ optyczny, składa się z przestrzennego rozkładu natężenia pojedynczej częstotliwości przestrzennej - obiektu, którego natężenie zmienia się jako (1 + a cos ωx), w którym x jest współrzędną przestrzenną, a jest stałą zwaną kontrastem, a ω jest zmienną, która określa fizyczne odstępy pików w rozkładzie intensywności. Obraz jest rejestrowany dla stałej wartości a i ω oraz zmierzonego kontrastu na obrazie. Stosunek tego kontrastu do a jest odpowiedzią na tę konkretną częstotliwość przestrzenną określoną przez ω. Teraz, jeżeli ω jest zmienne, a pomiar jest powtarzany, wówczas uzyskiwana jest odpowiedź częstotliwościowa.

Nieliniowe układy optyczne

Analogie opisane powyżej idą jeszcze dalej. Wiele układów optycznych jest nieliniowych, podobnie jak wiele układów elektronicznych jest nieliniowych. Film fotograficzny jest nieliniowym elementem optycznym, ponieważ równe przyrosty energii świetlnej docierające do filmu nie zawsze powodują równe przyrosty gęstości na filmie.

W tworzeniu obrazu występuje inny rodzaj nieliniowości. Kiedy obrazowany jest obiekt, taki jak dwie gwiazdy, wynikowy rozkład intensywności na obrazie jest określany poprzez najpierw znalezienie rozkładu intensywności utworzonego przez każdą gwiazdę. Rozkłady te należy następnie dodać razem w regionach, w których zachodzą na siebie, aby uzyskać ostateczny rozkład natężenia, jakim jest obraz. Ten przykład jest typowy dla niespójnego systemu obrazowania - tj. Światło emanujące z dwóch gwiazd jest całkowicie nieskorelowane. Dzieje się tak, ponieważ nie ma stałej zależności fazowej między światłem emitowanym przez dwie gwiazdy w dowolnym skończonym przedziale czasowym.

Podobna nieliniowość powstaje w obiektach oświetlonych światłem słonecznym lub innego termicznego źródła światła. Oświetlenie tego rodzaju, gdy nie ma ustalonego związku między fazą światła w dowolnej parze punktów wiązki padającej, uważa się za oświetlenie niespójne. Jeśli jednak oświetlenie obiektu jest spójne, wówczas istnieje stała zależność między fazą światła we wszystkich parach punktów padającej wiązki. Aby określić wynikową intensywność obrazu w tych warunkach dla obiektu dwupunktowego, należy określić amplitudę i fazę światła na obrazie każdego punktu. Powstała amplituda i faza są następnie określane przez zsumowanie w obszarach nakładania się. Kwadrat tej powstałej amplitudy to rozkład intensywności na obrazie. Taki system jest nieliniowy. Matematyka układów nieliniowych została opracowana jako gałąź teorii komunikacji, ale wiele wyników można wykorzystać do opisu nieliniowych układów optycznych.

Ten nowy opis układów optycznych był niezwykle ważny, ale nie był sam w sobie odpowiedzialny za odrodzenie badań i rozwoju w dziedzinie optyki. To nowe podejście zaowocowało opracowaniem zupełnie nowych gałęzi badań, w tym przetwarzania optycznego i holografii (patrz poniżej Przetwarzanie optyczne i holografia). Miał także wpływ, wraz z rozwojem komputerów cyfrowych, na koncepcje i wszechstronność projektowania i testowania obiektywów. Wreszcie wynalezienie lasera, urządzenia wytwarzającego koherentne promieniowanie, oraz opracowanie i wdrożenie teorii częściowo spójnego światła dało dodatkowy impuls niezbędny do zmiany tradycyjnej optyki na całkowicie nowy i ekscytujący temat.

Tworzenie obrazu

Odpowiedź impulsowa

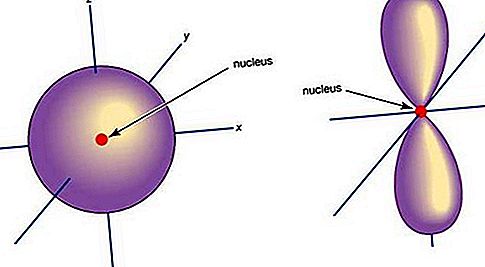

Układ optyczny, który wykorzystuje niespójne oświetlenie obiektu, zwykle może być uważany za układ liniowy o natężeniu. System jest liniowy, jeśli dodanie wejść powoduje dodanie odpowiednich wyjść. Dla ułatwienia analizy systemy często uważa się za stacjonarne (lub niezmienne). Ta właściwość implikuje, że jeśli położenie wejścia zostanie zmienione, wówczas jedynym efektem jest zmiana położenia wyjścia, ale nie jego faktyczny rozkład. Dzięki tym koncepcjom konieczne jest jedynie znalezienie wyrażenia dla obrazu punktu wejściowego, aby rozwinąć teorię tworzenia obrazu. Rozkład intensywności na obrazie obiektu punktowego można ustalić, rozwiązując równanie dotyczące dyfrakcji światła, gdy rozchodzi się ono od obiektu punktowego do soczewki, przez soczewkę, a następnie ostatecznie do płaszczyzny obrazu. Wynikiem tego procesu jest to, że intensywność obrazu jest intensywnością we wzorze dyfrakcji Fraunhofera funkcji apertury obiektywu (to znaczy kwadratu transformaty Fouriera funkcji apertury obiektywu; transformata Fouriera jest równaniem integralnym obejmującym elementy okresowe). Ten rozkład natężenia jest odpowiedzią impulsową natężenia (zwaną czasem funkcją rozproszenia punktu) układu optycznego i w pełni charakteryzuje ten układ optyczny.

Dzięki znajomości odpowiedzi impulsowej można obliczyć obraz znanego rozkładu intensywności obiektu. Jeśli obiekt składa się z dwóch punktów, wówczas w płaszczyźnie obrazu funkcja odpowiedzi impulsu natężenia musi znajdować się w punktach obrazu, a następnie dokonać sumy tych rozkładów natężenia. Suma jest ostateczną intensywnością obrazu. Jeśli dwa punkty są bliżej siebie niż połowa szerokości odpowiedzi impulsowej, nie zostaną one rozwiązane. W przypadku obiektu składającego się z szeregu izolowanych punktów stosuje się podobną procedurę - każda odpowiedź impulsowa jest oczywiście mnożona przez stałą równą wartości intensywności odpowiedniego obiektu punktowego. Zwykle obiekt będzie składał się z ciągłego rozkładu natężenia i zamiast prostej sumy powstanie całka splotowa.

Funkcja przesyłania

Do koncepcji funkcji przenoszenia układu optycznego można podchodzić na kilka sposobów. Formalnie i zasadniczo jest to transformata Fouriera odpowiedzi impulsu intensywności. Ponieważ odpowiedź impulsowa jest związana z funkcją przysłony obiektywu, podobnie jest z funkcją przenoszenia. W szczególności funkcję przenoszenia można uzyskać na podstawie wiedzy o funkcji przysłony, biorąc tę funkcję i wykreślając wynikowe nakładające się obszary, gdy funkcja apertury jest przesuwana nad sobą (tj. Autokorelacja funkcji apertury).

Koncepcyjnie jednak funkcję przenoszenia najlepiej zrozumieć, biorąc pod uwagę rozkład natężenia obiektu jako liniową sumę funkcji cosinus postaci (1 + a cos 2πμx), w której a jest amplitudą każdego składnika częstotliwości przestrzennej μ. Obraz rozkładu intensywności cosinusa jest cosinusem o tej samej częstotliwości; układ liniowy może wpływać tylko na kontrast i fazę cosinusa. Obraz powyższego rozkładu intensywności obiektu można przedstawić za pomocą [1 + b cos (2πμx + ϕ)], w którym b jest amplitudą wyjściowego cosinusa częstotliwości μ, a ϕ jest przesunięciem fazowym. Funkcja przenoszenia, τ (μ), dla tej częstotliwości jest następnie podawana przez stosunek amplitud:

Jeżeli μ jest teraz zmienny, przestrzenną odpowiedź częstotliwościową systemu mierzy się przez określenie τ (μ) dla różnych wartości μ. Należy zauważyć, że τ (μ) jest ogólnie złożone (zawiera termin z pierwiastkiem kwadratowym z √ 1).

Funkcja przenoszenia, podobnie jak odpowiedź impulsowa, w pełni charakteryzuje układ optyczny. Aby skorzystać z funkcji przenoszenia w celu ustalenia obrazu danego obiektu, należy go rozłożyć na szereg okresowych składników zwanych jego przestrzennym spektrum częstotliwości. Każdy termin w tej serii należy następnie pomnożyć przez odpowiednią wartość funkcji przenoszenia, aby określić poszczególne składowe serii, która jest przestrzennym spektrum częstotliwości obrazu - transformacja tej serii da intensywność obrazu. Zatem wszelkie komponenty w spektrum obiektów, których częstotliwość, dla której τ (μ) wynosi zero, zostaną wyeliminowane z obrazu.

Częściowo spójne światło

Rozwój i przykłady teorii

Tworzenie obrazu dotyczy powyżej niespójnego oświetlenia obiektu, co powoduje powstanie obrazu przez dodanie intensywności. Z drugiej strony badanie dyfrakcji i interferencji wymaga spójnego oświetlenia dyfrakcyjnego obiektu, a powstałe dyfrakcyjne pole optyczne jest określane przez dodanie złożonych amplitud zakłóceń falowych. Zatem istnieją dwa różne mechanizmy dodawania wiązek światła, w zależności od tego, czy wiązki są względem siebie spójne czy niespójne. Niestety, to nie jest cała historia; nie wystarczy wziąć pod uwagę tylko dwie sytuacje ściśle spójnego i ściśle niespójnego światła. W rzeczywistości ściśle niespójne dziedziny można w praktyce uzyskać tylko w przybliżeniu. Ponadto nie można zignorować możliwości pośrednich stanów koherencji; konieczne jest opisanie wyniku zmieszania niespójnego światła ze spójnym światłem. Miało to odpowiedzieć na pytanie Jak spójna jest wiązka światła? (lub równoważny, Jak niespójna jest wiązka światła?), że opracowano teorię częściowej spójności. Marcel Verdet, francuski fizyk, realizowany w 19 wieku, że nawet światło słoneczne nie jest całkowicie niespójna, a dwa obiekty oddzielone odległości ponad około 1 / 20 milimetra przyniesie efekty interferencyjne. Oko działające bez światła słonecznego nie rozwiązuje tej odległości oddzielenia, a zatem można uznać, że odbiera niespójne pole. Dwóch fizyków, Armand Fizeau we Francji i Albert Michelson w Stanach Zjednoczonych, byli również świadomi, że pole optyczne wytwarzane przez gwiazdę nie jest całkowicie niespójne, a zatem byli w stanie zaprojektować interferometry do pomiaru średnicy gwiazd na podstawie pomiaru częściowa spójność światła gwiazd. Ci pierwsi pracownicy nie myśleli jednak w kategoriach częściowo spójnego światła, ale osiągnęli swoje wyniki dzięki integracji nad źródłem. Z drugiej strony, wyjście z lasera może wytwarzać bardzo spójne pole.

Pojęcia częściowo spójnego światła można najlepiej zrozumieć za pomocą kilku prostych eksperymentów. Okrągłe jednolite odległe źródło wytwarza oświetlenie z przodu nieprzezroczystego ekranu zawierającego dwa małe okrągłe otwory, których odstęp można zmieniać. Obiektyw znajduje się za tym ekranem i uzyskuje się wynikowy rozkład intensywności w jego płaszczyźnie ogniskowej. Przy obu otworach otwartych samodzielnie obserwowany rozkład intensywności jest taki, że łatwo jest go powiązać z dyfrakcyjnym wzorem otworu, i można zatem wnioskować, że pole jest spójne w stosunku do wymiarów otworu. Kiedy dwa otwory są otwarte razem i znajdują się w ich najbliższej odległości, obserwuje się dwuwiązkowe prążki interferencyjne, które powstają w wyniku podziału czoła fali padającej przez dwa otwory. Wraz ze wzrostem odstępu między otworami obserwowane prążki interferencyjne stają się słabsze i ostatecznie zanikają, po czym ponownie pojawiają się nieznacznie wraz ze wzrostem odstępu. W miarę zwiększania się odstępu otworów wyniki te pokazują, że (1) zmniejsza się odstęp grzywki; (2) intensywności minimów skrajnych nigdy nie są równe zero; (3) względne natężenie maksimów powyżej minimów stale maleje; (4) wartość bezwzględna intensywności maksimów maleje, a wartość minimów wzrasta; (5) ostatecznie prążki znikają, w którym to momencie intensywność wynikowa jest tylko dwukrotnie większa niż intensywność obserwowana dla samego otworu (zasadniczo niespójny dodatek); (6) frędzle pojawiają się ponownie z dalszym wzrostem szczeliny, ale frędzle zawierają centralne minimum, a nie centralne maksimum.

Jeśli intensywności dwóch otworów są równe, wówczas wyniki (1) do (5) można podsumować, określając wielkość w kategoriach maksymalnej intensywności (I max) i minimalnej intensywności (I min), zwanej widocznością (V) na obrzeżach - tj. V = (I max - I min) / (I max + I min). Maksymalna wartość widzialności to jedność, dla której światło przechodzące przez jeden otwór jest spójne w stosunku do światła przechodzącego przez drugi otwór; gdy widzialność wynosi zero, światło przechodzące przez jeden otwór jest niespójne w stosunku do światła przechodzącego przez drugi otwór. Dla pośrednich wartości V światło jest uważane za częściowo spójne. Widoczność nie jest całkowicie zadowalającym opisem, ponieważ jest z definicji wielkością dodatnią i dlatego nie może zawierać opisu pozycji (6) powyżej. Ponadto w powiązanym eksperymencie można wykazać, że widoczność prążków można zmieniać, dodając dodatkową ścieżkę optyczną między dwiema przeszkadzającymi wiązkami.

Funkcja wzajemnej spójności

Kluczową funkcją w teorii światła częściowo spójnego jest funkcja wzajemnej koherencji Γ 1 2 (τ) = Γ (x 1, x 2, τ), wielkość zespolona, która jest uśrednioną w czasie wartością funkcji korelacji krzyżowej światło w dwóch punktach apertury x 1 i x 2 z opóźnieniem czasowym τ (odnoszącym się do różnicy ścieżek do punktu obserwacji prążków interferencyjnych). Funkcję można znormalizować (tzn. Ustawić jej wartość bezwzględną równą jedności przy τ = 0 i x 1 = x 2), dzieląc przez pierwiastek kwadratowy iloczynu natężeń w punktach x 1 i x 2, otrzymując kompleks stąd stopień spójności

Moduł γ 1 2 (τ) ma maksymalną wartość jedności i minimalną wartość zero. Zdefiniowana wcześniej widzialność jest identyczna z modułem złożonego stopnia spójności, jeśli I (x 1) = I (x 2).

Często pole optyczne można uznać za quasimonochromatyczne (w przybliżeniu monochromatyczne), a następnie opóźnienie czasowe można ustawić na zero w powyższym wyrażeniu, definiując w ten sposób funkcję wzajemnej intensywności. Często wygodnie jest opisać pole optyczne pod względem jego przestrzennej i czasowej spójności poprzez sztuczne oddzielenie zależnych od czasu i przestrzeni części funkcji koherencji. Czasowe efekty koherencji wynikają ze skończonej szerokości widmowej promieniowania źródłowego; czas koherencji Δt można zdefiniować jako 1 / Δν, w którym Δν jest szerokością pasma częstotliwości. Podobną długość koherencji DL może być również zdefiniowany jako C / Av = X 2 / Δλ 2, w którym C jest prędkością światła, λ oznacza długość fali, a Δλ pasma długości fali. Pod warunkiem, że różnice ścieżki w dodawanych belkach są mniejsze niż ta charakterystyczna długość, belki będą się zakłócać.

Termin spójność przestrzenna jest używany do opisania częściowej spójności wynikającej ze skończonej wielkości niespójnego źródła. Stąd dla pozycji ekwipunku do dodania dwóch wiązek przedział koherencji jest zdefiniowany jako separacja dwóch punktów, tak że wartość bezwzględna | γ 1 2 (0) | to pewna wstępnie wybrana wartość, zwykle zero.

Funkcja wzajemnej koherencji jest możliwą do zaobserwowania wielkością, która może być powiązana z intensywnością pola. Częściowo spójne pole może być propagowane za pomocą funkcji wzajemnej koherencji w podobny sposób do rozwiązania problemów dyfrakcyjnych przez propagację złożonej amplitudy. Efekty częściowo koherentnych pól mają wyraźne znaczenie w opisie normalnie spójnych zjawisk, takich jak dyfrakcja i interferencja, ale także w analizie normalnie niespójnych zjawisk, takich jak tworzenie obrazu. Warto zauważyć, że tworzenie obrazu w spójnym świetle nie ma liniowej intensywności, ale jest liniowe w złożonej amplitudzie pola, aw częściowo spójnym świetle proces jest liniowy we wzajemnej spójności.

Obróbka optyczna

Spójne układy optyczne

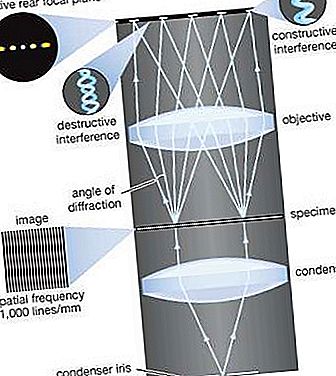

Przetwarzanie optyczne, przetwarzanie informacji, przetwarzanie sygnału i rozpoznawanie wzorów to wszystkie nazwy, które odnoszą się do procesu filtrowania częstotliwości przestrzennej w spójnym systemie obrazowania - w szczególności metody, w której wzór dyfrakcji Fraunhofera (równoważnie przestrzenne widmo częstotliwości lub transformata Fouriera) danego wejścia jest wytwarzany optycznie, a następnie obsługiwany w celu zmiany zawartości informacyjnej obrazu optycznego tego wejścia w z góry określony sposób.

Pomysł zastosowania spójnych układów optycznych w celu manipulacji zawartością informacyjną obrazu nie jest zupełnie nowy. Podstawowe idee są zasadniczo zawarte w teorii widzenia Abbe w mikroskopie opublikowanym po raz pierwszy w 1873 r.; kolejne eksperymenty ilustrujące tę teorię, zwłaszcza autorstwa Alberta B. Portera w 1906 r., są z pewnością prostymi przykładami przetwarzania optycznego.

Idee Abbe'a można interpretować jako uświadomienie, że tworzenie obrazu w mikroskopie jest bardziej poprawnie opisane jako spójny proces tworzenia obrazu niż jako bardziej znany proces niespójny. Zatem spójne światło oświetlające obiekt na stole mikroskopowym zostanie przez ten obiekt ugięte. Aby utworzyć obraz, to rozproszone światło musi zostać zebrane przez soczewkę obiektywu mikroskopu, a na charakter obrazu i rozdzielczość miałby wpływ ilość zebranego rozproszonego światła. Jako przykład można uznać obiekt składający się z okresowej zmiany transmitancji amplitudy - światło dyfrakowane przez ten obiekt będzie istniało w szeregu dyskretnych kierunkach (lub rzędach dyfrakcji). Ta seria rzędów zawiera rząd zerowy rozchodzący się wzdłuż osi optycznej i symetryczny zestaw rzędów po obu stronach tego rzędu zerowego. Abbe prawidłowo rozpoznał, co by się stało, gdy cel mikroskopu zaakceptował różne kombinacje tych rzędów. Na przykład, jeśli zbierane są zero i jeden pierwszy rząd, wówczas uzyskana informacja będzie taka, że obiekt składał się z rozkładu okresowego, ale przestrzenne położenie struktury okresowej nie jest poprawnie ustalone. Jeżeli uwzględniono drugi pierwszy rząd światła dyfrakcyjnego, uzyskuje się również prawidłowe położenie przestrzenne struktury okresowej. Wraz ze wzrostem liczby zamówień obraz bardziej przypomina obiekt.

Spójne optyczne przetwarzanie danych stało się poważnym przedmiotem badań w latach 50. XX wieku, częściowo z powodu pracy francuskiego fizyka Pierre-Michela Duffieuxa nad całką Fouriera i jej zastosowaniem w optyce oraz późniejszego zastosowania teorii komunikacji w badaniach optycznych. Prace zostały zainicjowane we Francji przez André Maréchala i Paula Croce, a dziś technika może rozwiązać szereg problemów. Obejmują one usunięcie linii rastrowych (jak na obrazie telewizyjnym) i kropek półtonowych (jak na ilustracji w gazecie); poprawa kontrastu; ostrzenie krawędzi; wzmocnienie sygnału okresowego lub izolowanego w obecności szumu addytywnego; równoważenie aberracji, w którym zarejestrowany aberrowany obraz można nieco poprawić; analiza widma; krzyżowa korelacja danych; dopasowane i odwrotne filtrowanie, w którym jasna plamka światła na obrazie wskazuje na obecność określonego obiektu.

Filtracja

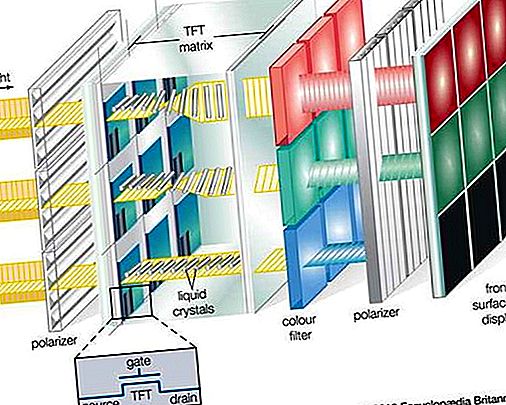

Podstawowy system wymagany do spójnego przetwarzania optycznego składa się z dwóch soczewek (ryc. 9). Skolimowana wiązka spójnego światła służy do transiluminacji obiektu. Pierwsza soczewka wytwarza charakterystyczny wzór dyfrakcji Fraunhofera dla obiektu, który jest przestrzennym rozkładem częstotliwości związanym z obiektem. (Matematycznie jest to transformata Fouriera rozkładu amplitudy obiektu.) Filtr, który składa się z amplitudy (gęstości) lub zmian fazy (ścieżki optycznej) lub obu, jest umieszczony w płaszczyźnie wzoru dyfrakcji. Światło przechodzące przez ten filtr jest wykorzystywane do utworzenia obrazu, a ten krok jest realizowany przez drugą soczewkę. Filtr ma wpływ na zmianę charakteru obrazu poprzez zmianę przestrzennego spektrum częstotliwości w kontrolowany sposób, tak aby poprawić niektóre aspekty informacji o obiekcie. Maréchal nadał opisowemu tytułowi podwójną dyfrakcję dla tego typu układu z dwoma soczewkami.

Filtry można dogodnie pogrupować w różne typy w zależności od ich działania. Filtry blokujące mają regiony o pełnej przezroczystości i inne regiony o całkowitej nieprzezroczystości. Nieprzezroczyste obszary całkowicie usuwają niektóre części widma częstotliwości przestrzennej obiektu. Za pomocą tego typu filtra można usunąć linie rastrowe i kropki półtonowe. Obiekt można uznać za funkcję okresową, której obwiednią jest scena lub obraz - lub równoważnie funkcja okresowa próbkuje obraz. Wzór dyfrakcyjny składa się z rozkładu okresowego o okresowości wzajemnie powiązanej z okresowością rastrową. W każdej z tych okresowych lokalizacji znajduje się dyfrakcyjny wzór sceny. Dlatego jeśli filtr jest otworem wyśrodkowanym w jednym z tych miejsc, tak że przepuszcza się tylko jeden z elementów okresowych, wówczas okresowość rastra jest usuwana, ale informacje o scenie są zachowywane (patrz rysunek 9). Problemem usuwania kropek półtonowych jest dwuwymiarowy odpowiednik powyższego procesu. Ponieważ dwuwymiarowe przestrzenne widmo częstotliwości obiektu jest wyświetlane w spójnym systemie przetwarzania optycznego, możliwe jest oddzielenie informacji za pomocą jego orientacji. Inne zastosowania filtrów blokujących obejmują filtry pasmowo-przepustowe, które ponownie mają bezpośredni związek z filtrami pasmowo-przepustowymi w obwodach elektronicznych.

Drugi rodzaj filtra to filtr amplitudowy, który będzie składał się z ciągłej zmiany gęstości. Filtry te można wytworzyć, aby uzyskać zwiększenie kontrastu wejścia obiektu lub różnicowanie obiektu. Często buduje się je poprzez kontrolowaną ekspozycję filmu fotograficznego lub odparowanie metalu na przezroczystym podłożu.

Niektóre techniki przetwarzania optycznego wymagają zmiany fazy pola optycznego, a zatem wymagany jest filtr bez absorpcji, ale o zmiennej grubości optycznej. Zwykle zarówno amplituda, jak i faza muszą zostać zmodyfikowane, co wymaga złożonego filtra. W prostych przypadkach części amplitudy i fazy można wytwarzać osobno, filtr fazowy wytwarza się przy użyciu odparowanej warstwy przezroczystego materiału, takiego jak fluorek magnezu. Obecna praktyka polega na wytwarzaniu złożonego filtra metodą interferometryczną, w której wymagana złożona funkcja amplitudy jest rejestrowana jako hologram (patrz poniżej Holografia).

Mikroskop z kontrastem fazowym może być uważany za przykład układu przetwarzania optycznego, a koncepcje rozumiane w odniesieniu do ryc. 9. Rozważana będzie tylko najprostsza forma. Tworzy się przestrzenne widmo częstotliwości obiektu fazowego, a fazę środkowej części tego widma zmienia się o π / 2 lub 3π / 2, aby wytworzyć odpowiednio dodatni lub ujemny kontrast fazowy. Aby poprawić kontrast obrazu, zastosowano dodatkowy filtr pokrywający ten sam obszar co filtr fazowy, który jest częściowo absorbujący (tj. Filtr amplitudowy). Ograniczeniem tego procesu jest to, że zmiany fazy ϕ (x) są małe, więc e i ϕ (x) ≅ 1 + iϕ (x). Przy niespójnym świetle informacja fazowa nie jest widoczna, ale wiele próbek biologicznych składa się tylko z odmian współczynnika załamania światła, co powoduje ścieżkę optyczną, a tym samym różnice fazowe. Obraz w mikroskopie z kontrastem fazowym jest taki, że intensywność na tym obrazie odnosi się liniowo, a zatem jest wyświetleniem informacji o fazie w obiekcie - np. I (x) ∝ 1 ± 2ϕ (x) dla dodatniego i odpowiednio ujemny kontrast fazowy.

Jedną z ważnych motywacji do badania metod przetwarzania optycznego jest osiągnięcie pewnej korekty zniekształconych obrazów. Znaczną przewagę technologiczną można uzyskać, jeśli zdjęcia wykonane za pomocą aberracji układu optycznego w niespójnym świetle mogą zostać skorygowane przez dalsze przetwarzanie. Można to osiągnąć w określonych granicach, ale odpowiedź impulsowa lub funkcja przenoszenia aberrowanego układu muszą być znane. Zarejestrowany rozkład intensywności obrazu jest splotem intensywności obiektu z odpowiedzią impulsową intensywności układu aberracji. Zapis ten stanowi dane wejściowe do spójnego systemu przetwarzania optycznego; wzór dyfrakcyjny utworzony w tym układzie jest iloczynem przestrzennego widma częstotliwości obiektu i funkcji przenoszenia układu aberracji. Koncepcyjnie, filtr musi być odwrotnością funkcji przenoszenia, aby zrównoważyć jego działanie. Ostateczny obraz byłby idealnie obrazem rozkładu intensywności obiektu. Bardzo ważne jest jednak, aby funkcja przesyłania miała skończoną wartość tylko w ograniczonym zakresie częstotliwości i tylko te częstotliwości, które są rejestrowane przez oryginalny system aberracji, mogą być obecne w przetwarzanym obrazie. Stąd, dla tych zarejestrowanych częstotliwości przestrzennych, można przeprowadzić pewne przetwarzanie, aby uzyskać bardziej efektywną funkcję przenoszenia; zarówno kontrast, jak i faza przestrzennego spektrum częstotliwości mogą wymagać zmiany, ponieważ funkcja przenoszenia jest na ogół funkcją złożoną. Najlepszymi przykładami są obrazy zniekształcone przez astygmatyzm, rozmycie lub ruch obrazu.

Holografia

Teoria

Holografia to dwuetapowy spójny proces tworzenia obrazu, w którym dokonuje się zapisu pośredniego złożonego pola optycznego związanego z przedmiotem. Wynalazek procesu rekonstrukcji czoła fali (obecnie zwany holografią) został po raz pierwszy opisany w 1948 r. Przez Dennisa Gabora, fizyka urodzonego na Węgrzech, z myślą o konkretnym zastosowaniu - w celu poprawy rozdzielczości obrazów utworzonych za pomocą wiązek elektronów. Technika ta odniosła jednak jak dotąd największy sukces, gdy wiązki światła są stosowane szczególnie w widzialnej części widma. Pierwszym krokiem w tym procesie jest zarejestrowanie (często na filmie o wysokiej rozdzielczości) wzoru interferencji powstającego w wyniku interakcji światła rozproszonego przez przedmiot będący przedmiotem zainteresowania i spójnego tła lub fali odniesienia. W drugim etapie zapis ten, którym jest hologram, jest spójnie podświetlany, aby utworzyć obraz oryginalnego obiektu. W rzeczywistości zwykle powstają dwa obrazy - obraz rzeczywisty (często nazywany obrazem sprzężonym) i obraz wirtualny (często nazywany obrazem podstawowym). U podstaw tego procesu leżą dwie podstawowe koncepcje: po pierwsze, dodanie spójnej wiązki tła (lub odniesienia). Można rozważyć dwa pola optyczne, których złożone amplitudy zmieniają się odpowiednio jako cosinus kąta proporcjonalnego do współrzędnej przestrzennej i jako moduł (wielkość bezwzględna) cosinusa kąta. Na podstawie pomiaru natężenia tych pól nie można ich rozróżnić, ponieważ oba różnią się jako cosinus do kwadratu współrzędnej kosmicznej. Jeśli jednak drugie spójne pole optyczne zostanie dodane do każdego z tych dwóch pól, wówczas pola wynikowe będą odpowiednio (1 + cos x) i (1 + | cos x |). Zmierzone intensywności są teraz różne, a rzeczywiste pola można określić, przyjmując pierwiastek kwadratowy z intensywności. Transmitancja amplitudowa zapisu fotograficznego jest w rzeczywistości pierwiastkiem kwadratowym pierwotnego rozkładu intensywności, który wystawiał film. W bardziej ogólnym znaczeniu pole optyczne w postaci a (x) exp [iϕ 1 (x)], w którym a (x) jest amplitudą, a ϕ 1 (x) jest fazą, można odróżnić od pola a (x) exp [iϕ 2 (x)] przez dodanie spójnego tła; fazy ϕ 1 (x) i ϕ 2 (x) są następnie zawarte jako cosinusowe zmiany intensywności w powstałym wzorze. W ten sposób omija się problem rejestrowania informacji fazowej pola optycznego. Jednak gdy hologram jest oświetlony, pole optyczne, które pierwotnie istniało w tej płaszczyźnie, jest odtwarzane. Aby zastosować drugą podstawową koncepcję - właściwość tworzenia obrazu - konieczne jest określenie, czym jest hologram obiektu punktowego - w rzeczywistości jest to strefowa strefa fali sinusoidalnej lub soczewka strefowa. Jeżeli do oświecenia soczewki strefowej zastosowana zostanie skolimowana wiązka światła, powstają dwie wiązki; pierwszy z nich skupia się na prawdziwym skupieniu, a drugi na rozbieżnej wiązce, która wydaje się pochodzić z wirtualnego skupienia. (Dla porównania, bardziej klasyczna płytka strefowa ma wiele rzeczywistych i wirtualnych ognisk, a prawdziwa soczewka ma tylko jedno.) Gdy obiekt jest inny niż punkt, soczewka strefowa jest modyfikowana przez dyfrakcyjny wzór obiektu; tj. każdy punkt na obiekcie wytwarza własną soczewkę strefową, a powstały hologram jest sumą takich soczewek strefowych.

W oryginalnym układzie Gabora hologram był zapisem interferencji między światłem ugiętym przez obiekt a kolinearnym tłem. To automatycznie ogranicza proces do tej klasy obiektów, które mają znaczne obszary, które są przezroczyste (patrz rysunek 10A). Kiedy hologram jest używany do utworzenia obrazu, powstają bliźniacze obrazy, jak pokazano na rysunku 10B. Światło związane z tymi obrazami rozchodzi się w tym samym kierunku, a zatem w płaszczyźnie jednego obrazu światło z drugiego obrazu pojawia się jako komponent nieostry. Ten typ hologramu jest zwykle określany jako liniowy hologram Fresnela, ponieważ jest to wzór obiektu, który zakłóca spójne tło współliniowe. Szkodliwe skutki drugiego obrazu można zminimalizować, jeśli hologram zostanie wykonany w dalekim polu obiektu, tak że jest to wzorzec dyfrakcji Fraunhofera obiektu, który jest zaangażowany. Ta ostatnia technika znalazła znaczące zastosowanie w mikroskopii, szczególnie w pomiarze małych cząstek oraz w mikroskopii elektronowej.

Bardziej wszechstronną metodą rejestrowania hologramu jest dodanie drugiej wiązki światła jako fali odniesienia w celu wytworzenia hologramu. Hologram jest teraz zapisem wzoru interferencyjnego wytwarzanego przez światło dyfrakcyjne przez obiekt i tę oddzielną falę odniesienia. Fala odniesienia jest zwykle wprowadzana pod kątem do rozproszonej wiązki, stąd ta metoda jest często nazywana holografią pozaosiową (lub pasmem bocznym). Gdy hologram jest oświetlony, wiązki tworzące obraz nie rozchodzą się w tym samym kierunku, ale są nachylone względem siebie pod kątem dwukrotnie większym niż kąt między ugiętą wiązką a pierwotną wiązką odniesienia. Dlatego światło związane z obrazem jest całkowicie oddzielone od drugiego obrazu.

Kolejną techniką, która ma pewną wartość i odnosi się do wcześniejszej dyskusji na temat przetwarzania optycznego, jest wytwarzanie tak zwanego hologramu uogólnionego lub transformaty Fouriera. Tutaj wiązka odniesienia jest dodawana spójnie do dyfraktogramu Fraunhofera obiektu lub tworzona przez soczewkę (jak w pierwszym etapie na ryc. 9).

Dotychczas opisany proces polegał na przepuszczaniu światła przez obiekt. Metody wykorzystujące oddzielną wiązkę odniesienia mogą być stosowane w świetle odbitym, a wirtualny (pierwotny) obraz wytworzony z hologramu ma wszystkie właściwości zwykłego obrazu pod względem trójwymiarowości i paralaksy. Zwykle zarejestrowany obraz jest jedynie dwuwymiarową reprezentacją obiektu. Hologramy w pełnym kolorze można nagrać, rejestrując zasadniczo trzy hologramy jednocześnie - jeden w czerwonym świetle, jeden w niebieskim i jeden w zielonym.

Aplikacje

Tworzenie obrazu

Wymienione tutaj aplikacje dzielą się na trzy grupy: aplikacje do tworzenia obrazu, aplikacje do nie-tworzenia obrazu oraz hologram jako element optyczny. Warto zauważyć, że wszystkie trzy grupy odnoszą się do podstawowego zastosowania procesu, a nie do konkretnych technik holograficznych. Pierwsza grupa obejmuje aplikacje wykorzystujące tworzenie obrazu, gdy z różnych powodów normalne niespójne lub spójne tworzenie obrazu nie jest zadowalające. Nie wystarczy jedynie zastąpić normalny proces obrazu techniką holograficzną, chyba że wystąpi znaczący wzrost - tzn. Wymaganego zapisu można uzyskać łatwiej lub dokładniej. Zastosowania należące do tej kategorii to mikroskopia holograficzna; analiza wielkości cząstek; szybkie fotografowanie różnego rodzaju, szczególnie przepływów gazu; przechowywanie i wyszukiwanie danych, w tym wyświetlaczy; tworzenie obrazu za pomocą losowego medium; oraz holografia nieoptyczna, szczególnie holografia akustyczna.

Nie tworzy obrazu

Druga grupa zainteresowań dotyczy aplikacji, które nie tworzą obrazu. Jednym z bardzo realnych i ekscytujących zastosowań holografii jest nieniszczące badanie wykonanych materiałów. Ciekawym przykładem tej metody jest testowanie opon w celu wykrycia wad (zadziorów), które występują między warstwami opony. Dziedzina interferometrii zostaje zatem rozszerzona na zupełnie nowe klasy obiektów. W podobnym, ale odrębnym opracowaniu, z powodzeniem zastosowano mikroskopię interferencyjną.

Elementy optyczne

Trzecia i ostatnia grupa obejmuje te aplikacje, które same wykorzystują hologram jako element optyczny. Obejmuje to budowę dokładnych, specjalistycznych siatek i zastosowanie filtrów holograficznych w spójnym optycznym przetwarzaniu danych.

Holografię dostosowano do konwencjonalnego mikroskopu, który jest modyfikowany przez włączenie oddzielnej wiązki odniesienia, tak że światło dyfrakowane przez obiekt w mikroskopie powoduje interferencję ze światłem z wiązki odniesienia. Zwiększenie dostępnej głębi ostrości uzyskuje się dzięki tego rodzaju procesowi nagrywania. Obraz powstaje, gdy hologram jest ponownie oświetlony spójną wiązką.

Zastosowanie holografii do analizy wielkości cząstek (np. W celu określenia rozkładu wielkości kropel pyłu i cieczy) było tak naprawdę pierwszym z współczesnych zastosowań. W pewnym sensie to również można uznać za mikroskopię. Zasady holografii Fraunhofera zostały opracowane w celu rozwiązania tego konkretnego problemu. Ponieważ cząstki są w ruchu, natychmiast należy wykonać hologram. Dlatego zastosowano technikę pulsacyjnego rubinu. Hologram jest utworzony między światłem rozproszonym przez cząstki lub krople a spójnym światłem tła, które przechodzi bezpośrednio przez próbkę. Podczas rekonstrukcji powstaje seria nieruchomych obrazów, które można badać w czasie wolnym. Dlatego zdarzenie przejściowe zostało przekształcone w nieruchomy obraz do oceny.

Przechowywanie i wyszukiwanie danych jest być może jednym z ważniejszych zastosowań holografii, która jest w trakcie opracowywania i udoskonalania. Ponieważ informacje o obrazie nie są zlokalizowane, nie mogą na nie wpływać zadrapania lub cząsteczki pyłu. Ostatnie postępy w dziedzinie materiałów, szczególnie tych, które mogą być kasowane i wielokrotnego użytku, dodatkowo zwiększyły zainteresowanie holograficznymi pamięcią optyczną.

Do aplikacji nie tworzących obrazu należą interferometria, mikroskopia interferencyjna i przetwarzanie optyczne. Holograficzną interferometrię można wykonać na kilka sposobów. Podstawowa technika obejmuje rejestrowanie hologramu obiektu będącego przedmiotem zainteresowania, a następnie zakłócanie obrazu wytworzonego z tego hologramu samemu spójnie oświetlonemu obiektowi. Odmianą tej techniki byłoby utworzenie dwóch hologramów w różnych momentach tego samego obiektu w trakcie testowania. Dwa hologramy można następnie wykorzystać razem, aby utworzyć dwa obrazy, które ponownie by się zakłócały. Widoczne prążki interferencyjne byłyby powiązane ze zmianami obiektu między dwiema ekspozycjami. Trzecia technika wykorzystuje uśredniony czasowo hologram, który jest szczególnie przydatny do badania drgających obiektów.

Istnieją dwa zastosowania, które obejmują holograficzne elementy optyczne - zastosowanie siatek holograficznych i zastosowanie filtrów holograficznych do spójnego optycznego przetwarzania danych.